4. DeepSeek

介绍 DeepSeek 系列模型的架构与训练方法

DeepSeek 技术发展

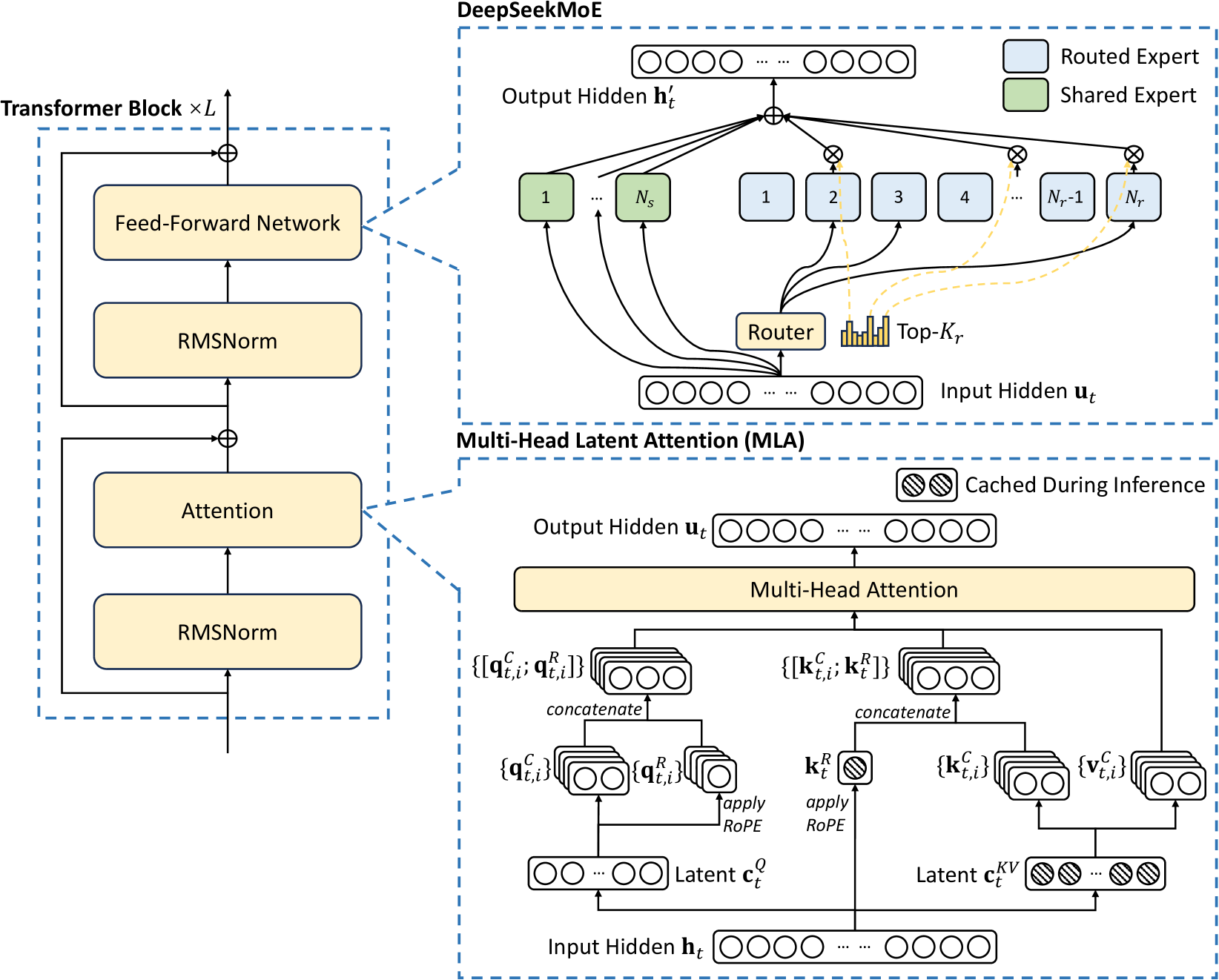

DeepSeek V3

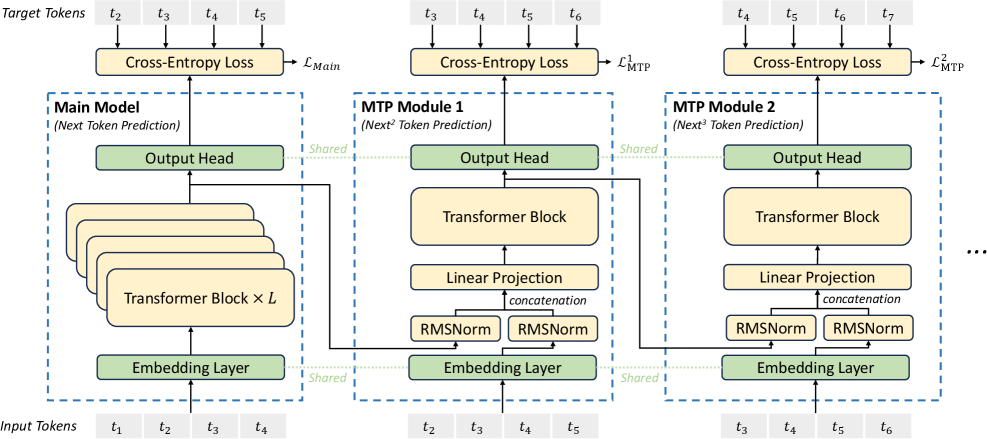

MTP架构

DeepSeek R1

DeepSeek R1-0528

DeepSeek V3.1

DeepSeek 3.2-Exp

DeepSeekMath V2

DeepSeek V3.2

Last updated

Was this helpful?